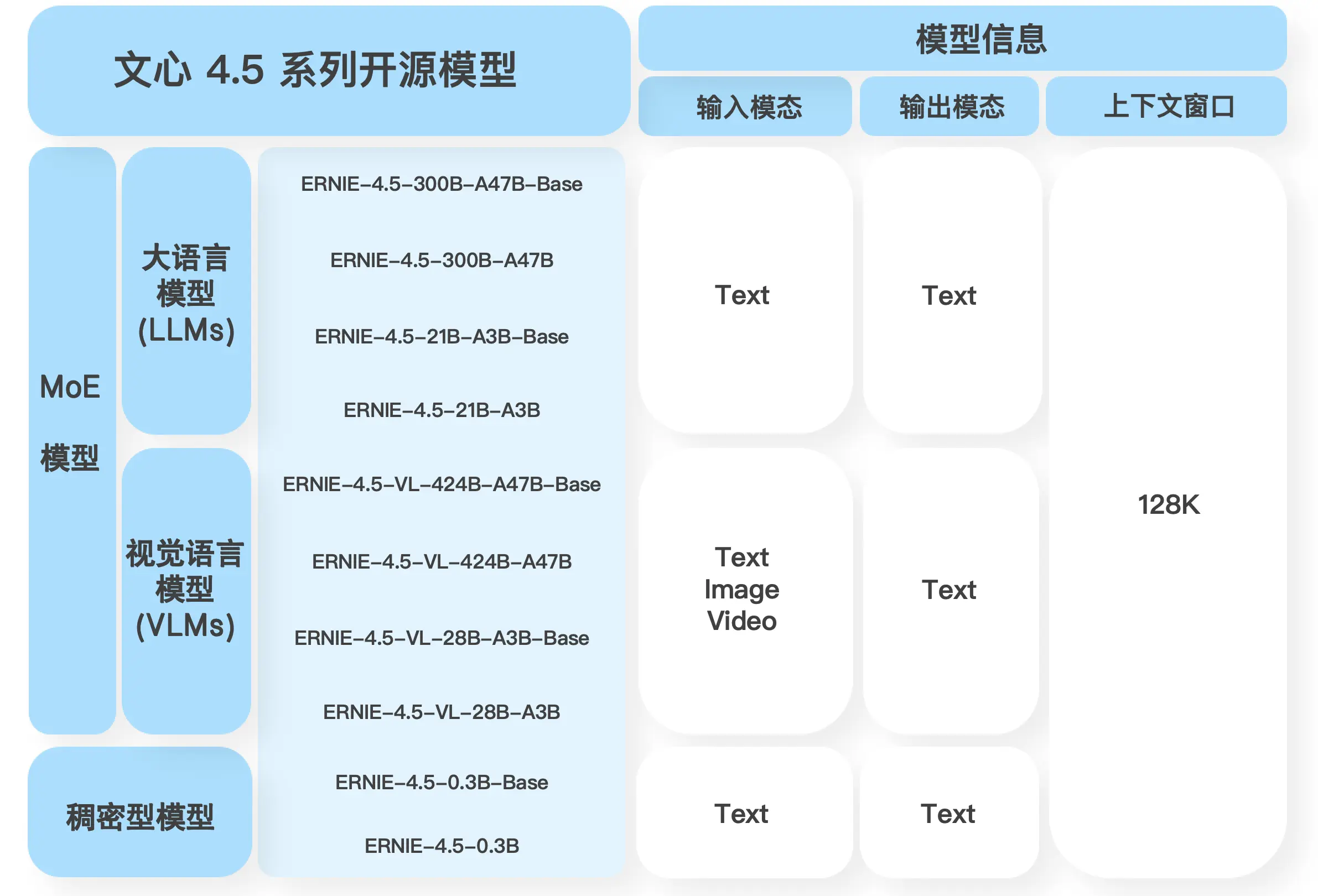

2025年6月30日,百度宣布文心4.5系列模型正式开源。此次开源包括10款不同规模的模型,其中包括参数量为47B和3B的混合专家(MoE)模型,以及0.3B的稠密参数模型。文心4.5的开源文件包括预训练权重和推理代码,已上传至Hugging Face、GitHub以及飞桨星河社区,供全球开发者使用。

主要技术特点

1. 多模态混合专家模型预训练

文心4.5通过联合训练文本和视觉两种模态来提高模型在多模态任务中的表现。该模型使用了多模态异构混合专家结构,结合了多维旋转位置编码,并在损失函数计算中增强了专家间的正交性。这一架构旨在提升模型对多模态信息的理解,同时保持不同模态的独立性。

2. 高效的训练与推理框架

文心4.5在训练过程中采用了异构混合并行和负载均衡策略,提升了训练吞吐量。推理方面,采用了量化技术(如4-bit和2-bit量化),以减少计算开销,并通过动态角色转换和解码分离部署等技术优化推理过程。这些措施旨在提高在不同硬件平台上的推理性能。

3. 后训练优化

文心4.5还对模型进行了后训练,以适应不同的实际应用需求。大语言模型(LLM)侧重于语言理解与生成任务,而多模态模型则优化了视觉语言理解。每个模型通过多阶段的后训练技术(如SFT和DPO)进行进一步优化,以确保其在特定任务中的表现。

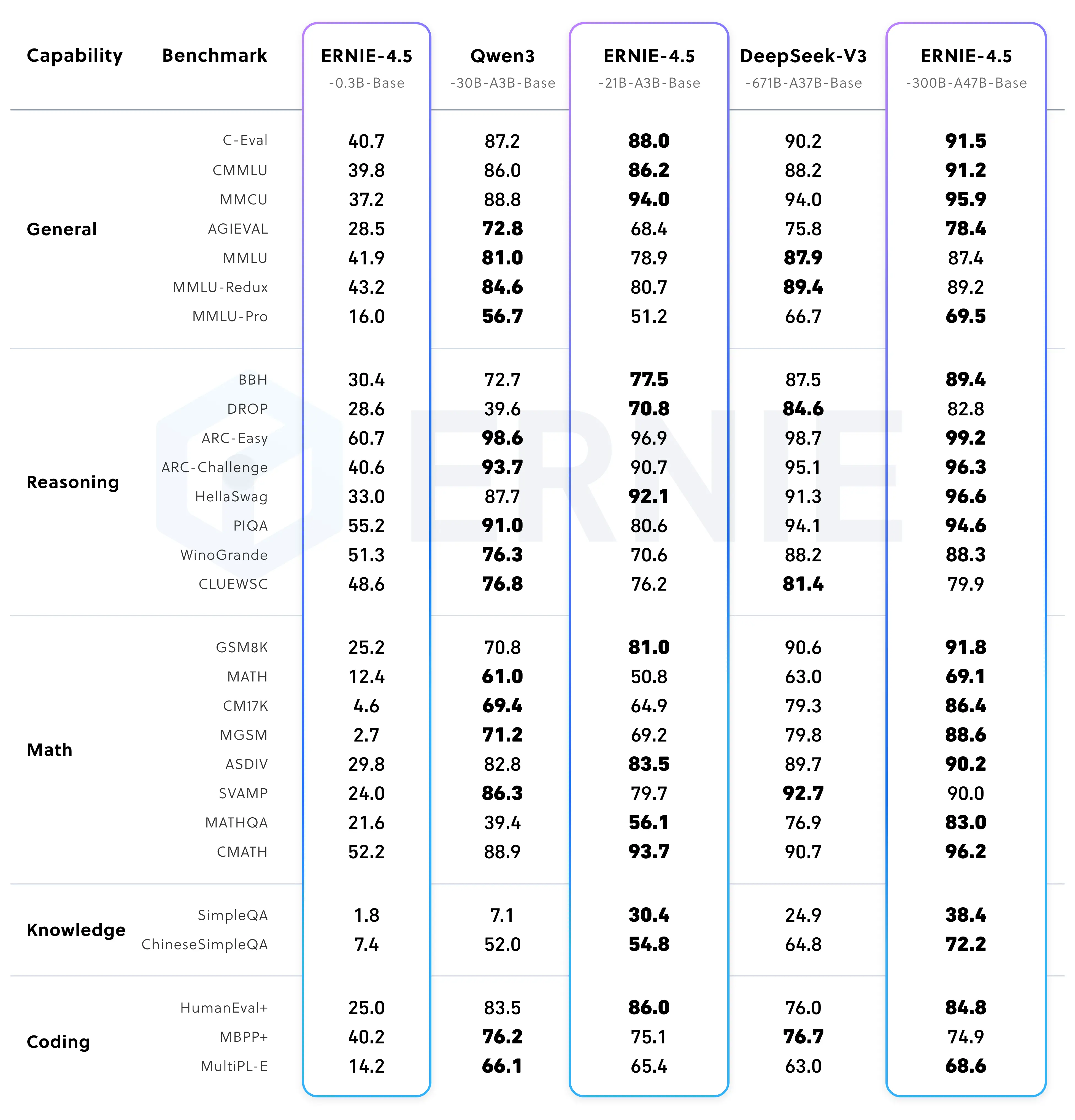

性能表现

文心4.5系列模型在多个基准测试中取得了良好的成绩。例如,ERNIE-4.5-300B-A47B模型在28个基准测试中超过了DeepSeek-V3模型,特别是在推理和知识密集型任务方面表现较好。ERNIE-4.5-21B-A3B模型尽管参数量较小,但在多个数学和推理任务中表现出了竞争力。

开源与开发工具

为了支持开发者的使用,文心4.5系列模型提供了一些开源工具:

- ERNIEKit:这是一个大模型开发套件,支持精调、量化训练等功能,帮助开发者快速适应模型的开发和部署。

- FastDeploy:这是一个模型部署工具,支持多硬件平台并优化了低比特量化推理,简化了部署过程。

这些工具的发布旨在帮助开发者更高效地使用和部署文心4.5模型。

如何使用文心4.5系列模型?

1、个人用户:

文心4.5系列模型已上线到文心一言(https://yiyan.baidu.com),支持免费体验。

2、企业和开发者:

- GitHub仓库:https://github.com/PaddlePaddle/ERNIE

- Hugging Face模型:https://huggingface.co/baidu

- 飞桨星河社区:https://aistudio.baidu.com/

- 技术报告:https://yiyan.baidu.com/blog/publication/ERNIE_Technical_Report.pdf