-

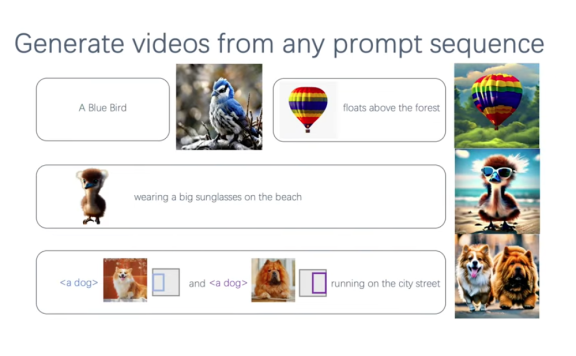

Pyramid-Flow:北大快手等联合推出的开源文生视频AI模型

Pyramid-Flow是由快手、北京大学和北京邮电大学联合组建的研究团队推出的开源超高清视频生成模型,该模型能根据文本描述生成最长 10 秒、分辨率高达 1280x768、帧率 24fps 的高质量视频。 -

Janus-Pro:DeepSeek推出的开源AI模型,支持图像理解和图像生成

Janus-Pro是由DeepSeek推出的开源大一统模型,支持图像理解和图像生成,提供 1B 和 7B 两种规模,适配多元应用场景。它通过改进的训练策略、扩展的数据集和更大规模的模型,显著提升了文本到图像的生成能力和指令跟随性能。 -

京东言犀大模型

京东言犀大模型是在2023京东全球科技探索者大会上推出的一种大模型。这个模型融合了70%的通用数据和30%的数智供应链原生数据,具有更高的产业属性、更强的泛化能力和更多的安全保障。它的目标是深入零售、物流、金融、健康、政务等知识密集型和任务型产业场景,解决真实的产业问题。 ? 官网链接:https://yanxi.jd.com/ 京东言犀大模型的工具链和基础设施 为了支持大模型的研发,京东推出了一… -

Emu2:智源研究院开源发布的新一代生成式多模态基础模型

2023年12月21日,智源研究院发布了新一代多模态基础模型 Emu2。Emu2通过大规模自回归生成式多模态预训练,显著推动了多模态上下文学习能力的突破。 Emu2在少样本多模态理解任务上表现出色,超越了主流多模态预训练大模型 Flamingo-80B 和 IDEFICS-80B。在 VQAv2、OKVQA、MSVD、MM-Vet、TouchStone 等多个少样本理解、视觉问答、主体驱动图像生成… -

-

华为-盘古AI大模型

根据华为云官网消息,华为旗下的盘古系列AI大模型即将上线,该系列AI大模型中的NLP大模型、CV大模型、科学计算大模型(气象大模型)已经标记为即将上线状态。 据悉,盘古大模型采用了深度学习和自然语言处理技术,并使用了大量的中文语料库进行训练。该模型拥有超过1千亿个参数,可以支持多种自然语言处理任务,包括文本生成、文本分类、问答系统等等。 其中,盘古NLP大模型是被认为最接近人类中文理解能力的AI大… -

PandaGPT-多模态AI大模型

首个实现了跨六种模态(图像/视频、文本、音频、深度、thermal和IMU)执行指令遵循数据的基础模型。在没有明确多模态监督的情况下,PandaGPT展现出了强大的多模态能力。 -

-

abab 6.5-MiniMax稀宇科技发布的万亿参数MoE大 模型

abab 6.5是国内 AI 初创企业 MiniMax 稀宇科技今日正式推出的 MoE 混合专家模型架构的系列大模型,核心能力开始接近 GPT-4、 Claude-3、 Gemini-1.5。 -

MatterGen:微软推出的无机材料设计AI模型,辅助生成新材料

MatterGen 是微软推出的基于生成性AI的材料设计模型,利用扩散模型生成具有特定化学、机械、电子或磁性属性的新材料。它能够高效生成稳定、独特的材料,超越传统筛选方法,快速探索未知材料空间。 -

MiracleVision-美图旗下AI视觉大模型

MiracleVision视觉大模型具有强大的视觉表现力和创作力,并从绘画、设计、影视、摄影、游戏、3D、动漫等视觉创作场景反推技术演化,擅长亚洲人像摄影、国风国潮、商业设计等生成方向。 -

LTX-Video:Lightricks开源的实时AI视频生成模型

LTXV是由Lightricks推出的基于DiT的首个实时AI视频生成开源模型,可以生成 24 FPS 768x512分辨率的 视频,比观看它们更快。该模型在包含各种视频的大规模数据集上进行训练,可以生成具有逼真和多样化内容的高分辨率视频。 -

SYMPLEX:北大推出的功能基因深度挖掘大模型

SYMPLEX 是由北京大学钱珑团队发布的功能基因深度挖掘大模型平台,专为生物制造和合成生物元件设计服务。平台结合大语言模型能力与结构化生物知识,能够从海量文献中自动提取与标注功能基因,并提供基因功能推荐、结构分析与知识图谱生成等功能,推动从序列到应用的基因资源发现。 -

Meta Movie Gen:Meta推出的AI视频音频生成模型

Meta Movie Gen是由Meta推出的AI视频音频生成模型,能够通过简单的文本输入生成高质量的视频和音效,还支持精准的视频编辑。用户可以输入文本描述生成高清视频、上传图像制作个性化视频,或根据指令修改视频内容。Movie Gen 还可以生成与视频同步的背景音乐和音效,适合内容创作者、电影制作人等使用。 -

CodeShell-北京大学开源的代码大模型

CodeShell是北京大学知识计算实验室联合四川天府银行AI团队研发的多语言代码大模型基座。CodeShell具有70亿参数,在五千亿Tokens进行了训练,上下文窗口长度为8192。在权威的代码评估Benchmark(HumanEval与MBPP)上,CodeShell取得同等规模最好的性能。 -

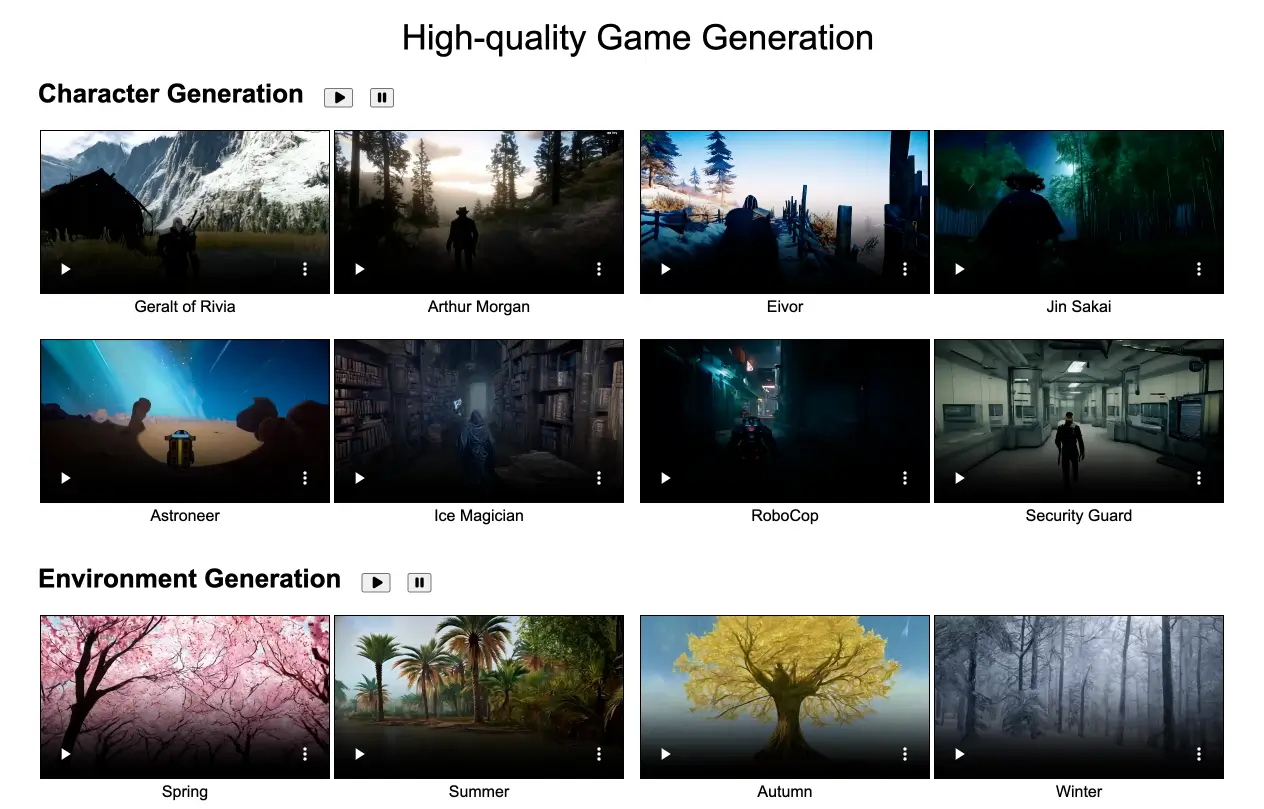

GameGen-O:腾讯推出的视频游戏生成模型,支持生成角色、环境和动作等

GameGen-O是腾讯推出的一款专门用于生成开放世界视频游戏的AI模型,它能够模拟游戏引擎功能,生成游戏角色、动态环境、复杂动作和事件,并支持互动控制。用户可以通过文本、操作信号和视频提示来实时控制游戏内容。GameGen-O 的推出标志着游戏开发进入了AI辅助的新阶段,简化了许多复杂的开发环节,降低了开发成本,甚至让普通用户也能轻松生成高质量的游戏内容。 -

Qwen2-阿里云最新发布的通义千问开源大模型

Qwen2是阿里云通义千问团队开源的新一代大语言模型,推出了5个尺寸的预训练和指令微调模型,在中文英语的基础上,训练数据中增加了27种语言相关的高质量数据;代码和数学能力显著提升;增大了上下文长度支持,最高达到128K tokens(Qwen2-72B-Instruct)。多个评测基准上的领先表现。现已在Hugging Face和ModelScope开源。 -

AndesGPT-OPPO旗下AI大模型

OPPO AndesGPT是OPPO公司自主开发的生成式大语言模型。它是一种人工智能技术,专门用于提升语音助手的性能。AndesGPT模型在SuperCLUE测评基准的排行榜上表现出色,特别是在“知识与百科”能力测试中,得分高达98.33,仅次于GPT4,排名国内第一。 -

CogVideoX-智谱推出的开源AI视频生成模型

CogVideoX是由智谱AI开发的视频生成大模型,具备强大的视频生成能力、只需输入文本或图片就可以轻松完成视频制作。此次开源的是CogVideoX-2B,20亿参数规格的模型,是CogVideoX 系列视频生成模型中的第一个模型,与智谱推出的AI视频生成产品清影同源。 -

美图发布 7 款影像生产力工具,推出视觉大模型

6 月 19 日消息,美图公司举办以“AI 时代的影像生产力工具”为主题的第二届影像节,现场发布 7 款新品:AI 视觉创作工具 WHEE;AI 口播视频工具开拍;桌面端 AI 视频编辑工具 WinkStudio;主打 AI 商业设计的美图设计室 2.0;AI 数字人生成工具 DreamAvatar;美图 AI 助手 RoboNeo;美图视觉大模型 MiracleVision。 IT之家从美图官方… -

-

M2UGen-腾讯发布的多模态音乐生成模型

M2UGen是一个多模态音乐理解和生成模型的项目。该项目利用大型语言模型的能力,结合MU-LLaMA模型、MosaicML的MPT-7B-Chat模型、BLIP图像字幕模型和VideoMAE字幕模型,生成音乐相关的数据集,并使用M2UGen模型进行音乐生成和理解。 -

讯飞星火语音大模型

讯飞星火认知大模型是科大讯飞推出的AI大语言模型,专注于提供高精度的语音识别和超拟人化的语音合成服务。它支持多种语言和方言,具备自动语种判断和智能标点功能,能够实现流畅的语音转文字和自然口语的语音输出。该模型适用于语音搜索、聊天输入、游戏娱乐、人机交互、智能客服等多个场景,为企业和开发者提供了强大的语音交互解决方案。 -

-

-

Step-1X:阶跃星辰推出的文生图AI大模型

Step-1X是阶跃星辰推出的文生图大模型,具备强大的图像生成能力,它能够通过输入的文本描述生成高质量、高分辨率的图像,特别擅长处理和理解中文文本。该模型使用自研的DiT架构,具备深度语义理解和细节捕捉能力,能够将复杂的文本语义转化为图像特征,生成与描述高度匹配的视觉内容。此外,Step-1X 还支持风格迁移,使其在广告创意、游戏美术、影视制作等领域的应用更为广泛。 -

Gemma 3:Google 推出的轻量级高性能开源模型,支持单个GPU运行

Gemma 3 是 Google 推出的轻量级、高性能开源模型,支持多种尺寸(1B、4B、12B 和 27B),专为单 GPU 或 TPU 设计。它支持 140 多种语言,具备高级文本和视觉推理能力,配备 128k-token 上下文窗口和函数调用功能,支持复杂任务处理。Gemma 3 提供量化版本,优化性能,降低计算需求,并配备安全特性。它无缝集成多种开发工具,支持灵活部署,助力开发者快速构建高… -

abab-video-1:MiniMax发布的AI高清视频生成模型

abab-video-1模型支持生成最高1280*720分辨率、25帧/秒的高清AI视频,视频内容具有电影感镜头移动,最多支持6秒视频的生成。 -

Pixtral Large:Mistral AI推出的开源千亿参数多模态 AI 模型

Pixtral Large 是由 Mistral AI 推出的 1240 亿参数开源多模态模型。它是基于 Mistral Large 2 构建的第二代多模态模型,能够同时处理 文本 和 图像 数据,专为复杂推理、文档分析和视觉理解任务设计。它在保持顶尖文本理解能力的同时,显著增强了图像相关任务的表现,适用于研究、教育和商业场景。 -

Llama 3.2:Meta最新推出的开源模型,包括视觉大语言模型和设备端纯文本模型

Llama 3.1是Meta最新推出的开源大语言模型,包括90B和11B两种参数规格的视觉大语言模型,还有能在设备端本地运行的1B和3B轻量级纯文本模型,包括预训练和指令调整版。1B和3B模型支持128K tokens上下文,适配高通和联发科硬件,并针对Arm处理器做了优化。 -

QVQ-Max:阿里通义推出的视觉推理模型,能分析图片和视频内容

QVQ-Max 是阿里巴巴通义团队推出的AI视觉推理模型,能够分析图片和视频内容,进行推理和解决问题。它具备细致的观察能力,能识别图像中的关键元素,并结合背景知识进行深度推理。 -

FLUX.1 Kontext [dev]:Black Forest Labs开源的图像编辑模型

FLUX.1 Kontext \[dev] 是 Black Forest Labs 推出的开源图像编辑模型,支持通过自然语言对图像进行局部修改,具备风格与角色一致性保持、多轮稳定编辑等能力。该模型基于 Flow Transformer 架构,编辑精度高、响应速度快,适合创作者、开发者和研究人员用于插画创作、视觉叙事和图像生成研究。 -

K1.5:Kimi 最新推出的多模态思考模型

Kimi k1.5 是Kimi推出的最新多模态思考模型,专为解决复杂的推理任务而设计。作为一款集数学推理、代码生成、视觉推理和多模态数据分析于一体的高性能AI模型,k1.5在推理速度和准确性上取得了突破性进展,标志着AI推理技术的进一步提升。 -

InstantCharacter:腾讯混元开源的定制化图像生成插件,支持角色一致性生成

InstantCharacter 是腾讯混元开源的一个定制化图像生成插件,能够通过简单的文字描述和一张图片生成各种角色的图像。它实现了对开源文生图模型 Flux 的兼容,用户只需要提供一张图片和一句话的描述,就可以让角色以想要的姿势出现在任何场景中。 -

Qwen3-Coder:阿里通义千问推出的代码模型,具备卓越的代码生成和 Agent 能力

Qwen3-Coder 是阿里巴巴通义千问团队发布的最新代码模型,具备卓越的代码生成和 Agent 能力。它拥有多个尺寸,其中最强大的版本是 Qwen3-Coder-480B-A35B-Instruct,这是一个 480B 参数激活 35B 参数的 MoE 模型,原生支持 256K token 的上下文,并可通过 YaRN 扩展到 1M token。 -

Mistral 7B - Mistral AI 发布的开源大语言模型

Mistral 7B 是法国AI初创公司 Mistral AI 发布的一款先进的 73亿参数语言模型,性能超越了 Llama 2 13B 和 Llama 1 34B。 -

GLM-Zero:智谱AI最新推出的AI深度推理模型

GLM-Zero是智谱AI推出的最新推理模型,专为解决数学、编程、常识问答等复杂任务而设计。该模型具备卓越的推理能力,能高效处理高级数学运算、逻辑推理、编程任务等,适用于教育、科研和技术开发等多个领域。凭借其强大的计算和推理能力,GLM-Zero为用户提供了精准、高效的解决方案,推动了生成式AI在多领域的应用和发展。 -

知彼阿尔法-企查查商业查询大语言模型

企查查“知彼阿尔法”商查大模型是全球首款商查垂直领域大模型,该模型基于企查查覆盖的全球企业信用数据进行训练,相较于当前AIGC(生成式人工智能)领域其它模型,企查查“知彼阿尔法”大模型最大的亮点在于用垂直领域的海量数据进行训练,保证信息的精准度。 -

AniSora - Bilibili开源的动漫视频生成模型,一键生成多种风格动漫视频镜头

AniSora是 Bilibili 推出的开源动漫视频生成模型,它支持一键生成多种动漫风格的视频镜头,包括番剧片段、国创动画、漫画改编、VTuber 内容、动画 PV、鬼畜(MAD)等。 -

腾讯混元T1:腾讯推出的最新深度思考推理模型

腾讯混元 T1 是腾讯推出的最新深度思考推理模型,具备强大的分析和推理能力,能够清晰、有依据地回答复杂问题。T1 还支持联网搜索,结合实时信息提供更准确的答案。

![FLUX.1 Kontext [dev]:Black Forest Labs开源的图像编辑模型](https://www.aihub.cn/wp-content/uploads/2025/06/FLUX-1-Kontext-dev.webp)