-

Step 3:阶跃星辰开源的多模态推理模型

Step 3 是阶跃星辰团队最新推出并开源的多模态推理模型,采用 MoE 架构,总参数量 321B,激活参数量 38B,上下文长度64k,拥有强大的视觉感知和复杂推理能力,可准确完成跨领域的复杂知识理解、数学与视觉信息的交叉分析,以及日常生活中的各类视觉分析问题。 -

-

Wan2.2 - 阿里通义开源的视频和图像生成模型

Wan2.2 是由阿里通义大模型团队发布的开源视频生成模型,专为电影级视觉控制和高质量视频创作设计。它通过混合专家(MoE)架构,实现了对电影镜头语言的深度理解和还原,支持多维度的视觉呈现,如光影、色彩和构图。 -

GLM-4.5:智谱AI推出的新一代开源旗舰AI模型

GLM-4.5 是由智谱 AI 推出的开源 SOTA 模型,专为智能体应用打造,具备卓越的推理、代码生成和智能体能力。采用混合专家架构,提供思考模式和非思考模式,满足复杂任务和即时响应需求。 -

Qwen-MT:阿里通义千问推出的机器翻译模型,支持92种语言互译

Qwen‑MT 是阿里云通义千问团队基于 Qwen3 开发的机器翻译大模型,采用轻量级 MoE 架构,支持 92 种官方语言及方言互译。 -

Qwen3-Coder:阿里通义千问推出的代码模型,具备卓越的代码生成和 Agent 能力

Qwen3-Coder 是阿里巴巴通义千问团队发布的最新代码模型,具备卓越的代码生成和 Agent 能力。它拥有多个尺寸,其中最强大的版本是 Qwen3-Coder-480B-A35B-Instruct,这是一个 480B 参数激活 35B 参数的 MoE 模型,原生支持 256K token 的上下文,并可通过 YaRN 扩展到 1M token。 -

Kimi K2:月之暗面开源的万亿参数 MoE 架构基础模型

Kimi K2 是月之暗面 Moonshot AI 推出的开源大型语言模型,采用 Mixture-of-Experts 架构,拥有总参数量达 1 万亿、32 B 激活参数,支持最长 128K 上下文长度,原生设计以实现“agentic intelligence”(自主任务执行与工具调用)。 -

AniSora - Bilibili开源的动漫视频生成模型,一键生成多种风格动漫视频镜头

AniSora是 Bilibili 推出的开源动漫视频生成模型,它支持一键生成多种动漫风格的视频镜头,包括番剧片段、国创动画、漫画改编、VTuber 内容、动画 PV、鬼畜(MAD)等。 -

ThinkSound - 阿里通义开源的AI音频生成模型

ThinkSound 是阿里通义实验室开源的首个音频生成模型,能够像专业音效师一样理解画面内容并进行结构化推理,从而生成高保真、与视觉高度同步的空间音频,适用于影视、短视频、游戏等多种创作场景。 -

-

-

百度正式开源文心4.5系列模型

2025年6月30日,百度宣布文心4.5系列模型正式开源。此次开源包括10款不同规模的模型,其中包括参数量为47B和3B的混合专家(MoE)模型,以及0.3B的稠密参数模型。文心4.5的开源文件包括预训练权重和推理代码,已上传至Hugging Face、GitHub以及飞桨星河社区,供全球开发者使用。 主要技术特点 1. 多模态混合专家模型预训练 文心4.5通过联合训练文本和视觉两种模态来提高模型… -

Qwen VLo - 阿里推出的多模态统一理解与生成模型

Qwen VLo 是通义千问团队推出的多模态统一理解与生成模型,具备强大的图文双向交互能力。它不仅能精准理解图像内容,还能根据自然语言指令进行高质量的图像生成与编辑,支持风格迁移、背景更换、物体添加等多种操作 -

FLUX.1 Kontext [dev]:Black Forest Labs开源的图像编辑模型

FLUX.1 Kontext \[dev] 是 Black Forest Labs 推出的开源图像编辑模型,支持通过自然语言对图像进行局部修改,具备风格与角色一致性保持、多轮稳定编辑等能力。该模型基于 Flow Transformer 架构,编辑精度高、响应速度快,适合创作者、开发者和研究人员用于插画创作、视觉叙事和图像生成研究。 -

Hailuo 02:MiniMax最新推出的AI视频生成模型

Hailuo 02 是 MiniMax 稀宇科技最新推出的AI视频生成模型,支持生成高质量1080p视频,擅长处理复杂指令和物理表现,如体操场景。 -

MiniMax-M1:MiniMax开源的大规模混合架构推理模型

MiniMax-M1 是MiniMax(稀宇科技)推出的全球首个开源大规模混合架构推理模型,具备卓越的长上下文处理能力和高效的推理性能。其支持高达100万上下文输入和8万Token输出,采用闪电注意力机制,显著提升算力效率。同时,该模型在软件工程、长上下文理解等复杂场景中表现优异,性价比极高,且提供免费不限量使用和低价格API服务。 -

dots.llm1:小红书开源的 MoE 架构大语言模型

dots.llm1是小红书开源的 MoE 架构大语言模型,拥有 1420 亿参数,推理仅激活 140 亿,兼顾性能与效率。模型基于 11.2 万亿非合成高质量数据训练,支持中英文,具备 32K 长上下文处理能力,并开放中间训练 checkpoint,适合问答、内容生成、语义理解等多种应用场景。 -

Speech 02:MiniMax 推出的新一代语音TTS模型,支持高质量多语种语音合成

MiniMax-Speech-02 支持多语言、高拟真语音生成,广泛应用于配音制作、虚拟人、教育、语音定制与无障碍沟通等场景,助力个性化语音内容高效生成与全球化传播。 -

Wan2.1-VACE:阿里开源的AI视频生成和编辑模型

通义万相 Wan2.1-VACE是阿里巴巴开源的AI视频生成与编辑模型,单一模型可同时支持文生视频、图像参考视频生成、视频重绘、视频局部编辑、视频背景延展以及视频时长延展等全系列基础生成和编辑能力。 -

Step1X-3D:阶跃星辰开源的3D大模型,支持生成高保真可控的3D内容

Step1X-3D 是由阶跃星辰正式发布并开源的一款3D大模型。该模型是继图像、视频、语音、音乐等模态后,阶跃星辰在多模态AI方向的最新成果,专注于生成高保真、可控的3D内容。 -

Seed1.5-VL:字节跳动推出的视觉-语言多模态基础模型

Seed1.5-VL 是字节跳动推出的视觉-语言多模态基础模型,结合图像编码器与200亿激活参数的大语言模型,具备出色的图像、视频理解与推理能力。在60项基准测试中获得38项SOTA,广泛应用于视频问答、图表理解、GUI智能体等任务,表现稳定、推理强大。 -

Matrix-Game:昆仑万维开源的交互式世界基础模型

Matrix-Game是由昆仑万维开源的交互式世界基础模型,能够生成完整可交互的游戏世界,能够对人类输入的操作指令进行正确响应,保留了游戏世界的空间结构与物理特性,画面也更加精致,超越了以往所有类似开源世界模型。 -

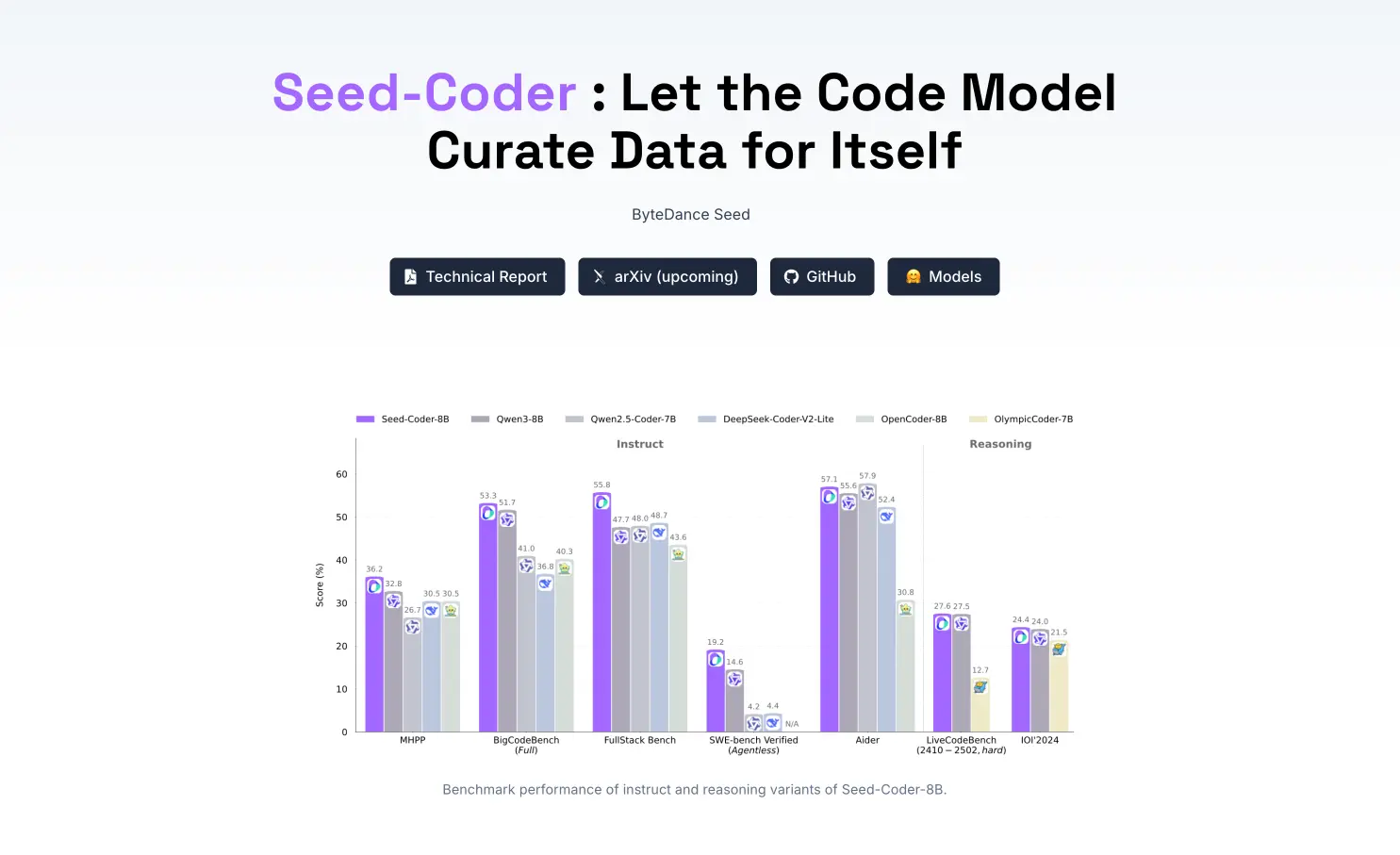

Seed-Coder:字节跳动最新推出的开源代码模型

Seed-Coder 是字节跳动开源的 8B(80亿参数)级代码大模型,它包括 Base、Instruct 和 Reasoning 三个版本,具备强大的代码生成、理解和推理能力。其最大亮点是采用“模型自助式”数据管道,利用大模型自动筛选和构建高质量训练数据,减少人工规则依赖。 -

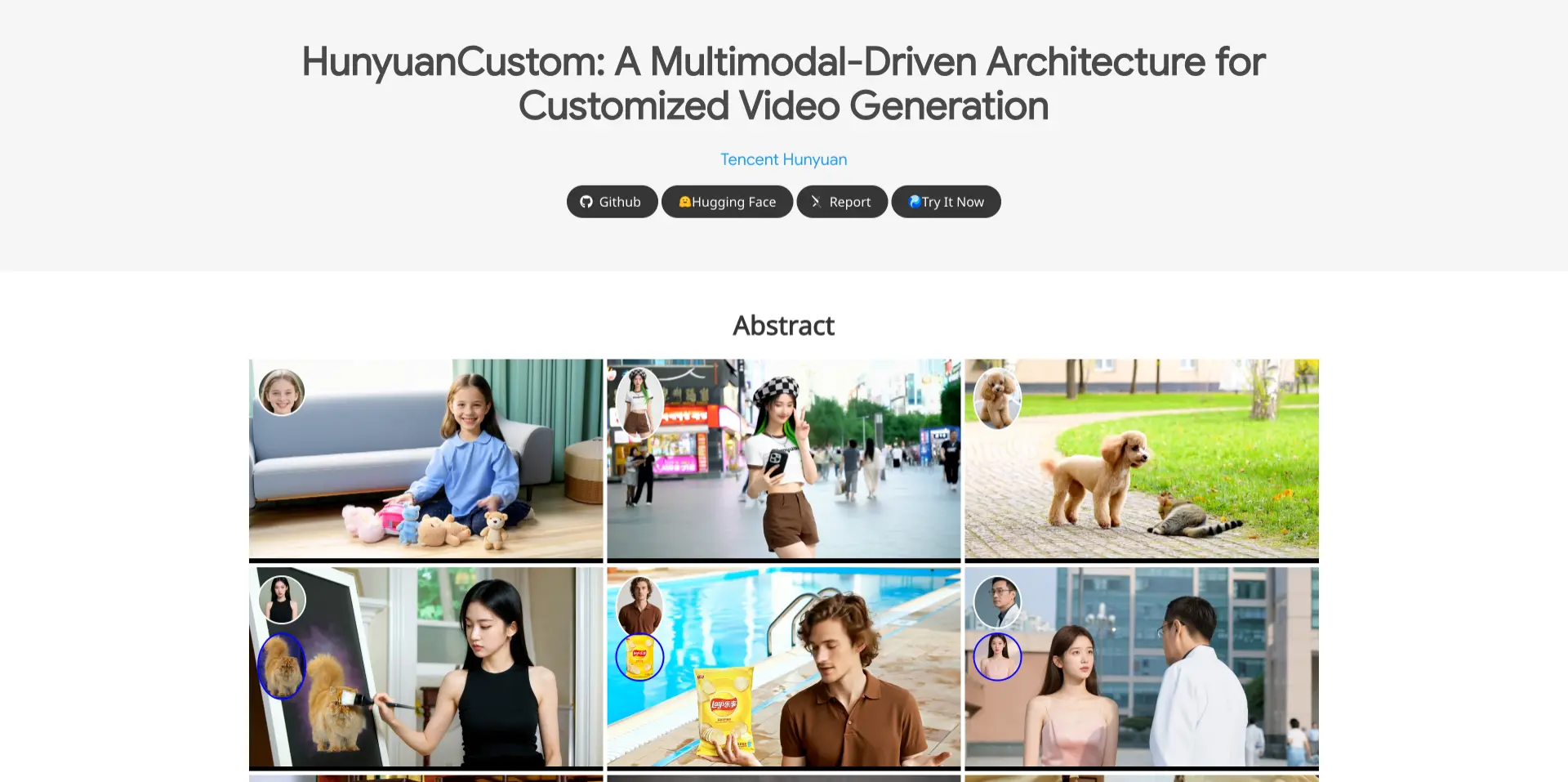

HunyuanCustom:腾讯混元开源的多模态定制化视频生成工具

HunyuanCustom是腾讯混元推出的一款多模态定制化视频生成工具,它基于混元视频生成大模型(HunyuanVideo)打造,融合了文本、图像、音频、视频等多模态输入,能够生成高质量的定制化视频。该工具在主体一致性效果上超越了现有的开源方案,具备高度控制力和生成质量。 -

ACE-Step:阶跃星辰和ACE Studio联合发布的开源音乐基础模型

ACE-Step 是由阶跃星辰与 ACE Studio 联合开源的音乐大模型,旨在为音乐爱好者提供高效、灵活且高质量的音乐创作工具。该模型参数量为 3.5B,具备多语言支持、快速生成、强可控性及易于拓展等特点,支持多种音乐创作场景,如音频编辑、人声合成、伴奏生成等。 -

DeepSeek-Prover-V2:DeepSeek最新开源的数学定理证明模型,参数量高达6710亿

DeepSeek-Prover-V2 是由 DeepSeek 最新开源的超大规模数学定理证明模型,参数量高达 6710 亿(671B),相比前代 Prover-V1.5(约 7B)提升近百倍,成为目前开源中最大规模的数学推理模型之一。该模型专为形式化数学证明设计,能够生成兼容 Lean 4 等主流证明助手的高质量证明步骤,支持复杂逻辑验证、定理发现与教学应用。 -

Xiaomi MiMo:小米推出的首个开源推理模型

MiMo 是小米推出的首个开源大语言模型,参数规模为 7B,聚焦于数学推理与代码生成任务。该模型通过高推理密度的预训练数据(总计 25 万亿 tokens)与强化学习后训练(包括奖励机制优化、样本再采样策略等),实现了在 AIME、LiveCodeBench 等多个权威基准上的领先表现。 -

Qwen3:阿里巴巴最新开源的混合推理大模型

Qwen3 是阿里巴巴推出的新一代大语言模型,支持119种语言,具备强大的推理、编码和智能体能力。它引入了“思考模式”和“快速响应模式”双模式切换,能根据任务灵活调节推理深度。Qwen3发布了多种规模的开源模型,旗舰版Qwen3-235B-A22B在多个领域性能达到业界顶尖,广泛应用于自然语言理解、复杂推理、代码生成等场景。 -

-

Kimi-Audio:Kimi开源的通用音频基础模型,支持语音识别、音频理解等多种任务

Kimi-Audio是kimi开源的全新通用音频基础模型,支持语音识别、音频理解、音频转文本、语音对话等多种任务,在十多个音频基准测试中实现了最先进的 (SOTA) 性能。 -

SkyReels-V2:昆仑万维开源的无限时长电影生成模型

SkyReels-V2 是由昆仑万维开源的一款视频生成大模型,首创“扩散强迫(Diffusion-forcing)”训练框架,具备生成高保真、连贯、长时长(30s 以上)的影视级视频的能力。模型融合了多模态大语言模型(MLLM)、强化学习、视频理解与扩散优化等多项技术,适用于故事生成、图像到视频(I2V)、运镜控制和多元素一致性生成等丰富场景。 -

InstantCharacter:腾讯混元开源的定制化图像生成插件,支持角色一致性生成

InstantCharacter 是腾讯混元开源的一个定制化图像生成插件,能够通过简单的文字描述和一张图片生成各种角色的图像。它实现了对开源文生图模型 Flux 的兼容,用户只需要提供一张图片和一句话的描述,就可以让角色以想要的姿势出现在任何场景中。 -

Gemini 2.5 Flash:Google 推出的首个完全混合推理模型

Gemini 2.5 Flash 是 Google 推出的首个完全混合推理模型,允许开发人员灵活控制模型的思考功能,可开启或关闭。它还支持设置思考预算,帮助开发者在质量、成本和延迟之间找到最佳平衡。即使关闭思考功能,模型仍能保持 2.0 Flash 的高速度,并进一步提升性能,兼具高效推理和成本效益。目前处于预览阶段,支持通过 API 在 Google AI Studio 和 Vertex AI … -

豆包1.5·深度思考模型:火山引擎推出的AI推理模型

在数学、编程、科学推理等专业领域及创意写作等通用任务中表现突出,在AIME 2024、Codeforces、GPQA等多项权威基准上达到或接近业界第一梯队水平。支持128k上下文窗口,16k输出。 -

OpenAI o4-mini:OpenAI最新推出的经济高效的推理模型

o4-mini 是OpenAI 发布的一款高效推理模型,专为快速、低成本的任务设计。它在数学、编程和视觉任务上表现出色,尤其适合高吞吐量场景。o4-mini 能自主使用 ChatGPT 的工具,如搜索、文件分析和代码执行,以快速生成答案。它还支持多模态输入,能处理图像和文本,对话自然且相关。其性价比高,是处理复杂问题的理想选择。 -

OpenAI o3:OpenAI推出的最新推理模型,支持工具调用和图像理解

OpenAI o3 是 OpenAI 发布的最新推理模型,代表了其在智能推理领域的最高水平。它能够自主使用 ChatGPT 内的所有工具,包括网络搜索、文件分析、代码执行和图像生成。 -

Seedream 3.0:字节推出的双语AI图像生成模型,支持原生 2K 分辨率

Seedream 3.0 是豆包大模型团队推出的下一代全场景文生图模型,支持原生 2K 分辨率图像生成,并具有显著提升的文本渲染、图像美学、结构优化能力。 -

林龙大模型:中国林科院推出的国内首个林草行业大模型

林龙大模型是中国林科院推出的国内首个林草行业大模型,基于DeepSeek大模型构建。它专为林草行业设计,融合多模态数据与行业知识,具备高效处理时空数据、低资源适配、高扩展性等优势,可应用于树种识别、病虫害监测、生态系统评估等八大场景,助力林草行业智能化转型与高质量发展。 -

GPT-4.1:OpenAI 推出的新一代语言模型,支持百万上下文

GPT-4.1 是 OpenAI 推出的新一代语言模型,包含 GPT-4.1、GPT-4.1 mini 和 GPT-4.1 nano 三个版本。它在编码能力、指令遵循和长文本处理等方面有显著提升,支持高达 100 万个 token 的上下文窗口。 -

SYMPLEX:北大推出的功能基因深度挖掘大模型

SYMPLEX 是由北京大学钱珑团队发布的功能基因深度挖掘大模型平台,专为生物制造和合成生物元件设计服务。平台结合大语言模型能力与结构化生物知识,能够从海量文献中自动提取与标注功能基因,并提供基因功能推荐、结构分析与知识图谱生成等功能,推动从序列到应用的基因资源发现。

![FLUX.1 Kontext [dev]:Black Forest Labs开源的图像编辑模型](https://www.aihub.cn/wp-content/uploads/2025/06/FLUX-1-Kontext-dev.webp)